Acheter Cryptos

Payer en

USD

Acheter & Vendre

Hot

Achetez et vendez des cryptomonnaies via Apple Pay, cartes bancaires, Google Pay, virements bancaires et d'autres méthodes de paiement.

P2P

0 Fees

Zéro frais, +400 options de paiement et une expérience ultra fluide pour acheter et vendre vos cryptos

Carte Gate

Carte de paiement crypto, permettant d'effectuer des transactions mondiales en toute transparence.

Trader

Basique

Spot

Échangez des cryptos librement

Marge

Augmentez vos bénéfices grâce à l'effet de levier

Convertir & Auto-investir

0 Fees

Tradez n’importe quel volume sans frais ni slippage

ETF

Soyez facilement exposé à des positions à effet de levier

Pré-marché

Trade de nouveaux jetons avant qu'ils ne soient officiellement listés

Avancé

DEX

Effectuez des transactions on-chain avec Gate Wallet

Alpha

Points

Obtenez des actifs prometteurs dans le cadre d'un trading on-chain rationalisé

Bots

Trade en un clic avec des stratégies intelligentes automatisées

Copier

Accroître sa richesse en suivant les meilleurs traders

CrossEx Trading

Beta

Un seul solde de marge, partagé par toutes les plateformes

Futures

Futures

Des centaines de contrats réglés en USDT ou en BTC

TradFi

Or

Tradez des actifs traditionnels mondiaux avec des USDT en un seul endroit

Options

Hot

Tradez des options classiques de style européen

Compte unifié

Maximiser l'efficacité de votre capital

Trading démo

Lancement Futures

Préparez-vous à trader des contrats futurs

Événements futures

Participez à des événements pour gagner de généreuses récompenses

Trading démo

Utiliser des fonds virtuels pour faire l'expérience du trading sans risque

Earn

Lancer

CandyDrop

Collecte des candies pour obtenir des airdrops

Launchpool

Staking rapide, Gagnez de potentiels nouveaux jetons

HODLer Airdrop

Conservez des GT et recevez d'énormes airdrops gratuitement

Launchpad

Soyez les premiers à participer au prochain grand projet de jetons

Points Alpha

Tradez des actifs on-chain et profitez des récompenses en airdrop !

Points Futures

Gagnez des points Futures et réclamez vos récompenses d’airdrop.

Investissement

Simple Earn

Gagner des intérêts avec des jetons inutilisés

Investissement automatique

Auto-invest régulier

Double investissement

Acheter à bas prix et vendre à prix élevé pour tirer profit des fluctuations de prix

Staking souple

Gagnez des récompenses grâce au staking flexible

Prêt Crypto

0 Fees

Mettre en gage un crypto pour en emprunter une autre

Centre de prêts

Centre de prêts intégré

Gestion de patrimoine VIP

La gestion qui fait grandir votre richesse

Gestion privée de patrimoine

Gestion personnalisée des actifs pour accroître vos actifs numériques

Fonds Quant

Une équipe de gestion d'actifs de premier plan vous aide à réaliser des bénéfices en toute simplicité

Staking

Stakez des cryptos pour gagner avec les produits PoS.

Levier Smart

New

Pas de liquidation forcée avant l'échéance, des gains à effet de levier en toute sérénité

Mint de GUSD

Utilisez des USDT/USDC pour minter des GUSD et obtenir des rendements de niveau trésorerie

Plus

Promotions

Centre d'activités

Participez aux activités et gagnez des récompenses en espèces et des produits exclusifs

Parrainage

20 USDT

Gagnez 40 % de commission ou jusqu’à 500 USDT de récompenses

Affiliés

Bénéficiez des commissions exclusives et des rendements élevés

Annoncement

Annonces de nouvelles inscriptions, activités, mises à jour, etc

Blog Gate

Articles sur le secteur de la crypto

Services VIP

Frais ultra-réduits

Preuve de réserves

Gate promet une preuve de réserves à 100 %

TradFi

Connect stocks, metals, commodities, forex, and indices

Gestion des actifs

New

Solution complète de gestion des actifs

Institutionnel

New

Solutions professionnelles de gestion d'actifs numériques pour les institutions

Virement Bancaire OTC

Dépôt et retrait fiat

Programme pour les Brokers

Mécanismes de remboursement API avantageux

Gate Booster

Expand your influence and enjoy massive

Gate Vault

Assurez la sécurité de vos actifs

Sujets populaires

Afficher plus25.98K Popularité

67.95K Popularité

12.81K Popularité

39.55K Popularité

253.09K Popularité

Hot Gate Fun

Afficher plus- 1

雨

雨の金

MC:$2.4KDétenteurs:10.00% - MC:$0.1Détenteurs:00.35%

- MC:$2.41KDétenteurs:10.00%

- MC:$2.4KDétenteurs:10.00%

- MC:$2.41KDétenteurs:20.07%

Épingler

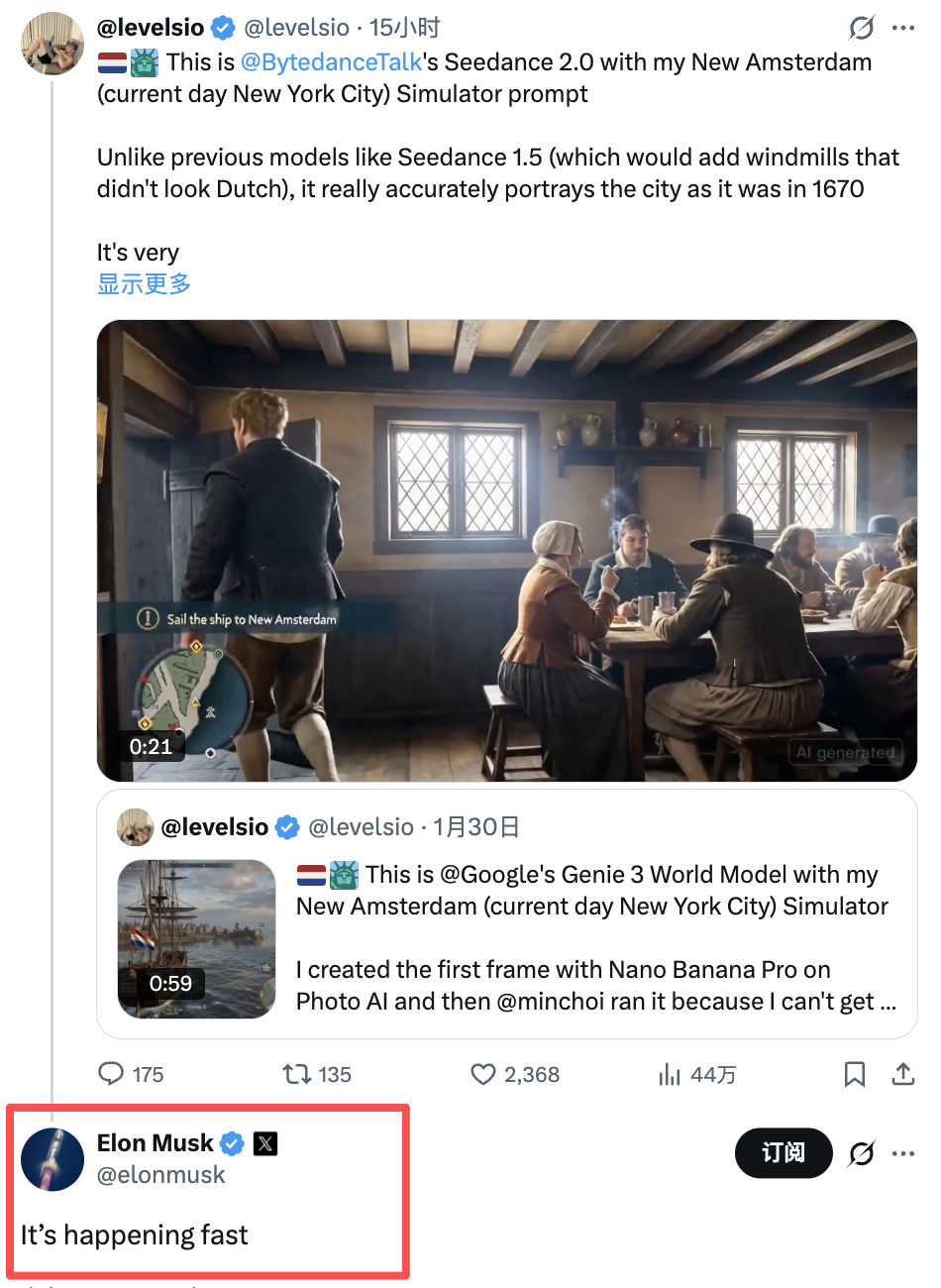

« La vitesse de développement est trop rapide » ! Elon Musk a apprécié Seedance 2.0, ByteDance affirme « encore loin d’être parfait »

Les modèles vidéo génératifs accélèrent leur entrée dans les produits grand public et les chaînes d’outils pour entreprises. Après la sortie du modèle de création vidéo Seedance 2.0 par ByteDance, celui-ci a rapidement connu un succès à l’étranger, et a commenté sur X « It’s happening fast », amplifiant ainsi l’attention du marché sur la progression des capacités de génération vidéo.

a commenté sur X « It’s happening fast », amplifiant ainsi l’attention du marché sur la progression des capacités de génération vidéo.

Les dernières actualités proviennent des plateformes sociales. Elon Musk a commenté une publication relative à Seedance 2.0 sur X en exprimant sa surprise face à la rapidité du développement, ce qui a maintenu l’engouement autour de ce modèle à l’étranger, tout en renforçant l’attention portée à sa contrôlabilité et à ses capacités de production.

ByteDance a aujourd’hui envoyé un signal clair concernant la commercialisation. Seedance 2.0 a été officiellement lancé, intégrant pleinement Doubao et Jiumeng, et a également été mis en ligne dans le centre d’expériences Volcano Ark, accessible en version d’essai pour les utilisateurs. Le modèle met en avant la synchronisation audio-visuelle, la narration longue multi-caméras, la génération contrôlable multimodale, etc., visant un public plus large de créateurs et de scénarios commerciaux.

Cependant, l’entreprise reste prudente dans ses déclarations. La micro-communication officielle de ByteDance indique que Seedance 2.0 « est encore loin d’être parfait », et que les résultats de génération présentent encore de nombreux défauts, tout en poursuivant l’exploration d’un alignement profond entre grands modèles et retours humains. Pour les acteurs du marché, cette combinaison de « forte exposition + commercialisation rapide + itérations continues » renforce l’anticipation d’un rythme de compétition accéléré dans le domaine de la génération vidéo.

Elon Musk partage et pousse l’engouement à l’étranger

Après le lancement de la phase de test interne, Seedance 2.0, grâce à sa création multimodale et à ses effets de « mouvement intégré », a suscité une attention mondiale élevée. La repost de Musk sur X avec le commentaire « It’s happening fast » a permis à la diffusion de ce modèle de passer d’un cercle technologique à un public plus large d’investisseurs et de consommateurs de produits technologiques.

L’évaluation publique de Musk, bien qu’elle n’aborde pas de détails techniques précis, renforce la narration sur « la vitesse de développement ». Ce signal ** contribue à augmenter l’intérêt extérieur pour les capacités multimodales de ByteDance, et pourrait également influencer marginalement les attentes d’évaluation des chaînes industrielles concernées.**

De l’expérimentation interne à l’intégration complète : Doubao, Jiumeng et Volcano Ark en simultané

ByteDance a annoncé aujourd’hui que le modèle de génération vidéo Doubao Seedance 2.0 a été intégré officiellement dans l’application Doubao, sur ordinateur et en version web, tout en étant pleinement connecté à Doubao et Jiumeng, et que le centre d’expériences Volcano Ark est désormais accessible en version d’essai.

Pour le secteur des entreprises, ByteDance indique que d’ici la mi-février, l’API de Seedance 2.0 sera déployée dans Volcano Ark, afin d’aider les clients à concrétiser leurs idées créatives. Cela signifie que Seedance 2.0 ne se limite pas à un outil de création, mais se prépare également à une utilisation plus standardisée côté B2.

Multimodal, narration longue et synchronisation audio-visuelle, ciblant « des scénarios de production professionnels »

ByteDance insiste sur le positionnement de Seedance 2.0 comme atteignant « des exigences professionnelles en termes de qualité et de contrôlabilité ». Les signaux clés côté fonctionnalités incluent :

1, Entrée multimodale supportant la combinaison de texte, images, audio et vidéo, en s’inspirant de la composition, des mouvements, du mouvement de caméra, des effets spéciaux, du son, etc.

2, Synchronisation audio-visuelle en temps réel et sortie multi-piste, supportant la musique de fond, les effets sonores ambiants ou les commentaires, avec un alignement précis sur le rythme visuel.

3, Narration longue multi-caméras avec « pensée de réalisateur », le modèle pouvant analyser automatiquement la logique narrative, générer une séquence de plans tout en maintenant l’unité des personnages, de la lumière, du style et de l’atmosphère.

4, Ajout de capacités d’édition vidéo et de prolongation, renforçant le flux de travail « à la niveau de réalisateur ».

ByteDance indique également que Seedance 2.0 a bien résolu des défis tels que le respect des lois physiques et la cohérence à long terme, avec un taux d’utilisation dans des scénarios en mouvement atteignant le niveau SOTA de l’industrie.

« Encore loin d’être parfait » : limites et restrictions clairement intégrées dans la présentation du produit

ByteDance affirme que Seedance 2.0 atteint un niveau de performance leader dans l’industrie, mais qu’il reste des marges d’optimisation, notamment en termes de stabilité des détails, de correspondance multi-personnes, de cohérence multi-entités, de précision de restitution textuelle et d’effets d’édition complexes, tout en poursuivant l’alignement profond entre grands modèles et retours humains.

Les règles de conformité et de limites d’utilisation deviennent également plus claires. ByteDance indique que pour l’instant, Seedance 2.0 limite l’utilisation d’images ou vidéos de personnes réelles comme référence principale, et que toute utilisation de personnes réelles doit faire l’objet d’une vérification ou d’une autorisation. Ces restrictions auront un impact direct sur la production et la diffusion de certains contenus commerciaux.

Lancement prévu le 14 février, rythme de mise à jour comme nouveau facteur

ByteDance a confirmé que Volcano Engine prévoit de lancer une série de mises à jour importantes pour Doubao, notamment le 14 février 2026, comprenant Doubao Model 2.0, le modèle de création audio-vidéo Seedance 2.0, le modèle d’image Seedream 5.0 Preview, avec des améliorations significatives des capacités des modèles de base et des agents d’entreprise.

Face à l’éloge de Musk sur la « vitesse de développement trop rapide », le marché se concentrera désormais sur deux points : premièrement, si le déploiement de l’API Seedance 2.0 et l’adoption par les entreprises suivent le rythme annoncé, et deuxièmement, si le rythme d’amélioration des faiblesses telles que la cohérence, la synchronisation labiale et l’édition complexe pourra soutenir la transition d’une démonstration « virale » à une « productivité stable ».

Avertissement de risque et clause de non-responsabilité